Een systeem voor versterkingsleren bestaat uit een beleid ( π {{{}}  ), een beloningsfunctie ( R {{}}

), een beloningsfunctie ( R {{}}  ), een waardefunctie ( v {{}}

), een waardefunctie ( v {{}}  ), en een optioneel model van de omgeving.

), en een optioneel model van de omgeving.

Een beleid vertelt de agent wat hij in een bepaalde situatie moet doen. Het kan een eenvoudige tabel met regels zijn, of een ingewikkelde zoektocht naar de juiste actie. Beleid kan zelfs stochastisch zijn, wat betekent dat in plaats van regels het beleid waarschijnlijkheden toekent aan elke actie. Een beleid op zich kan een agent dingen laten doen, maar het kan niet uit zichzelf leren.

Een beloningsfunctie definieert het doel voor een agent. Het neemt een toestand (of een toestand en de actie die in die toestand is ondernomen) en geeft een getal terug dat de beloning wordt genoemd en dat de agent vertelt hoe goed het is om in die toestand te zijn. Het is de taak van de agent om een zo groot mogelijke beloning te krijgen op de lange termijn. Als een actie een lage beloning oplevert, zal de agent in de toekomst waarschijnlijk een betere actie ondernemen. De biologie gebruikt beloningssignalen zoals plezier of pijn om ervoor te zorgen dat organismen in leven blijven om zich voort te planten. Beloningssignalen kunnen ook stochastisch zijn, zoals een gokautomaat in een casino, waar ze soms wel en soms niet uitbetalen.

Een waardefunctie vertelt een agent hoeveel beloning hij zal krijgen als hij een beleid π {\pi}  volgt vanuit toestand s {\i}

volgt vanuit toestand s {\i}  . Het geeft aan hoe wenselijk het is om in een bepaalde toestand te zijn. Omdat de waardefunctie niet direct aan de agent wordt gegeven, moet hij een goede schatting maken op basis van de beloning die hij tot nu toe heeft gekregen. De schatting van de waardefunctie is het belangrijkste onderdeel van de meeste algoritmen voor versterkingsleren.

. Het geeft aan hoe wenselijk het is om in een bepaalde toestand te zijn. Omdat de waardefunctie niet direct aan de agent wordt gegeven, moet hij een goede schatting maken op basis van de beloning die hij tot nu toe heeft gekregen. De schatting van de waardefunctie is het belangrijkste onderdeel van de meeste algoritmen voor versterkingsleren.

Een model is de mentale kopie van de agent van de omgeving. Het wordt gebruikt om toekomstige acties te plannen.

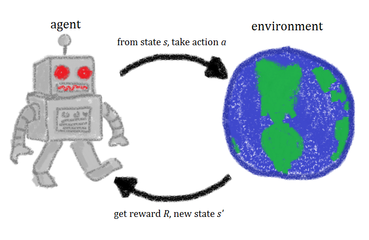

Nu we dit weten, kunnen we het hebben over de hoofdlus voor een episode van het versterkingsleren. De agent interageert met de omgeving in discrete tijdstappen. Zie het als de "tik-tak" van een klok. Bij discrete tijd gebeuren er alleen dingen tijdens de "ticks" en de "tocks", en niet daartussen. Op elk tijdstip t = 0 , 1 , 2 , 3 , . . . {\displaystyle t=0,1,2,3,... }  observeert de agent de toestand van de omgeving S t {\displaystyle S_{t}}

observeert de agent de toestand van de omgeving S t {\displaystyle S_{t}} en kiest een actie A t {\displaystyle A_{t}}

en kiest een actie A t {\displaystyle A_{t}} op basis van een beleid π {\displaystyle \pi }}.

op basis van een beleid π {\displaystyle \pi }}.  . In de volgende tijdstap ontvangt de agent een beloningssignaal R t + 1 {{t+1}}

. In de volgende tijdstap ontvangt de agent een beloningssignaal R t + 1 {{t+1}}  en een nieuwe waarneming S t + 1 {{t+1}}

en een nieuwe waarneming S t + 1 {{t+1}}  . De waardefunctie v ( S t ) {\displaystyle v(S_{t})}

. De waardefunctie v ( S t ) {\displaystyle v(S_{t})} wordt met behulp van de beloning geactualiseerd. Dit gaat door totdat een eindtoestand S T {S_{T}}

wordt met behulp van de beloning geactualiseerd. Dit gaat door totdat een eindtoestand S T {S_{T}} is bereikt.

is bereikt.